ETL-Datenverarbeitung

Skalierbare ETL-Datenverarbeitung für Ihr Unternehmen

Moderne Unternehmen generieren täglich riesige Mengen an Daten aus unterschiedlichsten Quellen. ETL (Extract, Transform, Load) ist der Prozess, der diese Daten extrahiert, transformiert und in ein einheitliches Format überführt, um wertvolle Erkenntnisse zu gewinnen.

Elasticbrains entwickelt maßgeschneiderte ETL-Pipelines, die Ihre Daten aus verschiedenen Quellen sammeln, bereinigen, anreichern und in Ihre Zielsysteme laden. Wir helfen Ihnen, Datensilos aufzulösen und eine einheitliche Datenbasis für bessere Entscheidungen zu schaffen.

Skalierbare Architektur

ETL-Pipelines, die mit Ihrem Datenvolumen wachsen und auch große Datenmengen effizient verarbeiten.

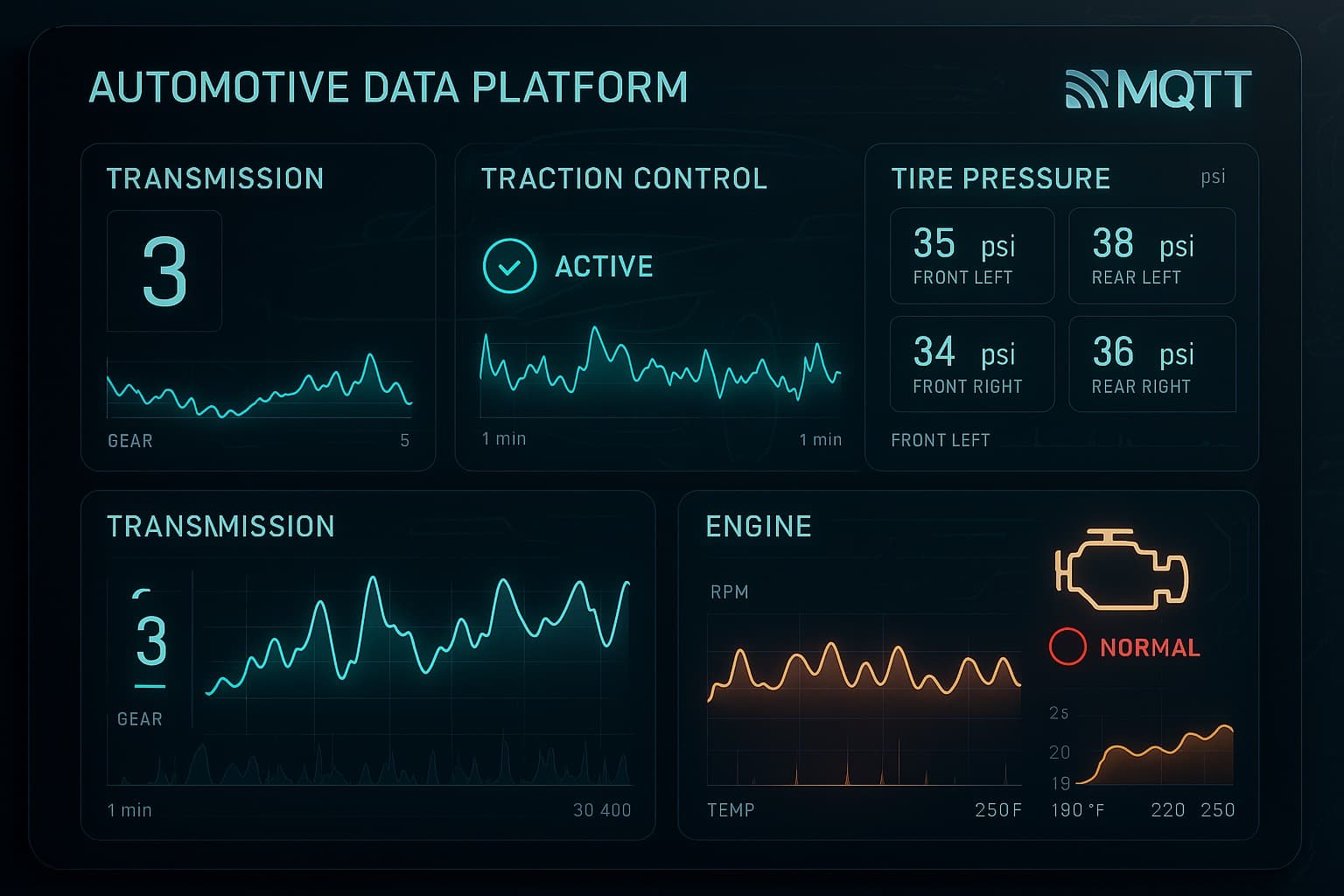

Echtzeit-Verarbeitung

Streaming-ETL für zeitkritische Daten und Batch-Processing für regelmäßige Datenimporte.

Datenqualität

Automatische Validierung, Bereinigung und Anreicherung Ihrer Daten für höchste Qualität.

Überwachung & Alerts

Umfassendes Monitoring mit automatischen Benachrichtigungen bei Fehlern oder Anomalien.

Unsere ETL-Lösungen

Datenintegration

Wir verbinden Ihre heterogenen Datenquellen – von Datenbanken über APIs bis hin zu Cloud-Speichern – und schaffen eine einheitliche Datenbasis.

Datentransformation

Wir entwickeln komplexe Transformationslogiken, die Ihre Rohdaten in aussagekräftige, strukturierte Informationen umwandeln.

Data Warehouse Integration

Wir implementieren ETL-Prozesse für Data Warehouses und Data Lakes, optimiert für analytische Abfragen und Business Intelligence.

Stream Processing

Wir bauen Echtzeit-ETL-Pipelines mit Technologien wie Apache Kafka, um zeitkritische Daten sofort zu verarbeiten.

Automatisierung

Wir automatisieren Ihre Datenflüsse mit Scheduling, Error Handling und automatischen Wiederholungen bei Fehlern.

Technologien und Tools

Apache Airflow

Workflow-Orchestrierung für komplexe ETL-Pipelines mit umfangreichem Monitoring und Scheduling.

Apache Kafka

Stream-Processing-Plattform für Echtzeit-Datenverarbeitung und Event-Streaming.

Apache Spark

Big-Data-Processing-Framework für hochperformante Verarbeitung großer Datenmengen.

Talend / Pentaho

Enterprise-ETL-Tools für grafische Entwicklung und Verwaltung von Datenintegrationsprozessen.

Cloud ETL Services

AWS Glue, Azure Data Factory, Google Cloud Dataflow für skalierbare Cloud-native ETL-Lösungen.

Custom Python/Node.js

Maßgeschneiderte ETL-Skripte mit Pandas, SQLAlchemy und anderen modernen Bibliotheken.

Anwendungsfälle

Business Intelligence

Datenextraktion aus operativen Systemen für Reporting und Analyse in BI-Tools.

Datenmigration

Sichere Migration großer Datenbestände bei Systemwechseln oder Cloud-Migrationen.

Datenkonsolidierung

Zusammenführung von Daten aus verschiedenen Unternehmensbereichen in ein zentrales System.

API-Datenintegration

Automatischer Import von Daten aus externen APIs (CRM, ERP, Social Media, etc.).

Starten Sie mit ETL-Datenverarbeitung

Unser Expertenteam entwickelt eine maßgeschneiderte ETL-Strategie für Ihr Unternehmen, die Ihre Datenquellen integriert, Datenqualität sicherstellt und eine solide Basis für datengetriebene Entscheidungen schafft.